Ловись, рыбка, большая и маленькая!

-

ПопулярностьТоп-89

-

Постов8,265

-

Просмотров1,174,950

-

Подписок218

-

Карма автора+18,393

-

Ты так пишешь как будто у всех любителей одинаковый скил и они просто между собой трут рейк.Если рег

+32

-

:) пусть в хедзапах будет ТАК: в оффлайне ТАК: в семье ТАК: с друзьями ТАК: в пятницу вечер

+30

-

Потому что она эту хуйню уже два года назад просчитала

+24

-

хорошо, что не фулл хаус)

+22

-

Привет, случайно наткнулся, напишу тоже пару слов, может, поможет. ^^Скорее, устаешь, потому что пье

+19

-

-

Штык @ 01.02.26

Пишите, что думаете на эту тему

Ну а кто ж не думает. Об этом трудно не думать.

Попалось вчера на глаза

ИИ-психоз стал системной проблемой — к такому выводу пришли исследователи.

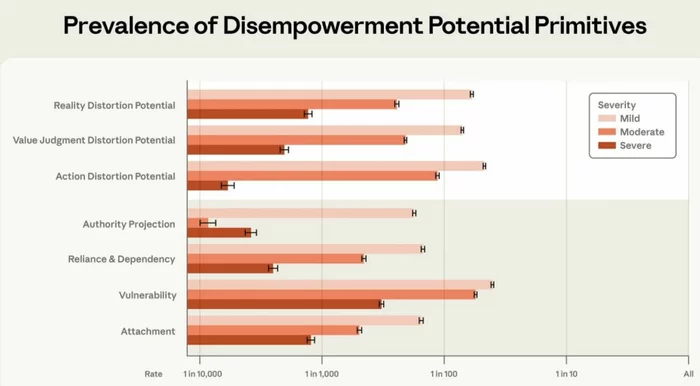

Учёные из Anthropic и University of Toronto проанализировали (https://arxiv.org/pdf/2601.19062) почти 1,5 миллионов диалогов с ИИ и выяснили: примерно один из 1300 разговоров приводит к искажению восприятия реальности, а один из 6 тысяч — к опасным действиям.

Исходя из этих цифр можно сделать вывод, что пострадавших — тысячи, но многие из них так и не обратились за помощью. Самое тревожное — число таких случаев растёт.Супруга переслала статейку. Задумаешься тут...

Под спойлер уберу, а то много текста и может не всем интересно.

Автор Ольга Райнхолдт.

ИИ-психоз. Разберу природу этого явления именно как специалист по высшим психическим функциям.

Это принципиально важно, потому что одна высшая психическая функция — речь — в ИИ реально исполняется, а другая высшая психическая функция — мышление — лишь имитируется.

Кроме того, я работаю с организациями и всё чаще вижу, как ИИ массово используется в рабочем контексте: для анализа, принятия решений, интерпретаций, оценки людей и ситуаций.

Это действительно даёт серьёзные преимущества, но одновременно резко увеличивает риски, которые в организациях сейчас практически не осмысляются и не контролируются.

ИИ — это очень мощный инструмент, и именно поэтому он опасен. Здесь работает простой технологический закон: любое радикальное преимущество всегда приносит с собой радикальные риски.

Когда был изобретён автомобиль, он полностью изменил способ передвижения людей, но вместе с этим появился колоссальный риск травм и смертей. Именно поэтому возникли правила дорожного движения, обучение, экзамены и ограничения. Без этого автомобиль как технология мог бы оказаться просто неприемлемо опасным.

С ИИ сейчас происходит ровно то же самое. Технология есть, leverage есть, а культуры безопасного использования нет.

Разработчики частично контролируют риски на уровне продукта, но пользователи — практически никак. Это выглядит так, как если бы автомобили оснастили ремнями безопасности, подушками и системами стабилизации, но никому не объяснили, что такое скорость, дистанция и встречное движение.

Разница лишь в том, что здесь вред не физический, а психологический, а психологический вред опасен тем, что он накапливается медленно и проявляется тогда, когда уже серьёзно нарушены высшие психические функции.

Ключевое, что необходимо понимать: ИИ не является интеллектом. То, что называют искусственным интеллектом, — это большая языковая модель. Она работает исключительно с текстом.

Она не сверяет свои ответы с реальностью, она сверяет текст с другими текстами и выстраивает вокруг этого нарратив. Текст — это единственная "реальность", к которой языковая модель имеет доступ.

Человеческое мышление устроено принципиально иначе. Его функция — опознавать реальность, отражать её, осмыслять и обеспечивать адаптацию к ней. В патопсихологии есть чёткий критерий: когда мышление перестаёт выполнять функцию отражения и познания реальности, оно становится патологическим.

В этом смысле large language model — это пример мышления без сверки с реальностью вообще. Не плохого мышления, а отсутствия самой функции мышления.

Там есть только высокоскоростная, убедительная и статистически согласованная генерация текста.

Иллюзия того, что ИИ "понимает" и "мыслит", возникает потому, что совпадения с реальностью действительно периодически есть, особенно если модель обучена на текстах, которые эту реальность отражают.

Из-за огромных объёмов таких совпадений они выглядят убедительно, и человек делает ложный вывод, что весь текст в целом отражает реальность.

В этот момент происходит ключевая ошибка: человек начинает делегировать ИИ функцию мышления.

Но мышления там нет. В результате собственное мышление выключается как ненужное, а взамен не появляется никакого другого мышления. Остаётся только резонёрский текст, оторванный от реальности, но оформленный максимально убедительно.

Психологическая опасность ИИ усиливается тем, что он создаёт эхо-камеру.

Он структурно ориентирован на подтверждение, поддержку, согласие и снижение фрустрации.

Он не возвращает человека к реальности, не сопротивляется его убеждениям и не проверяет их истинность, если его специально об этом не попросили.

При этом общение с ИИ снижает потребность в социальной адаптации: проще и приятнее взаимодействовать с моделью, которая не конфликтует, не ставит границ и не требует учитывать другого субъекта. Это напрямую бьёт по социальному мышлению и усиливает изоляцию.

Дополнительно ИИ создаёт иллюзию анализа. Убедительный, логичный текст воспринимается как мышление, хотя на самом деле это лишь симуляция.

Поскольку языковая модель способна выстроить убедительный нарратив вокруг любой идеи, она одинаково хорошо подтверждает как здравые, так и откровенно бредовые конструкции. Именно поэтому у человека может начать формироваться картина мира, которая вообще никак не связана с реальностью.

При этом ИИ не является абсолютным злом и не должен быть полностью исключён. Он действительно полезен как инструмент обработки текста. Он хорошо работает, когда используется для извлечения цитат, выжимок, сопоставлений и навигации по большим массивам информации. Если в него загружается качественная литература, написанная реальным мышлением, соотнесённым с реальностью, и если модель жёстко ограничена этим материалом, она может существенно ускорять освоение знаний.

Но при этом важно понимать, что никаких мыслей туда не добавляется. Мысли должны быть либо в исходном материале, либо у пользователя, а желательно в комбинации.

Самая большая ошибка — это делегирование ИИ оценки реальности, истинности, интерпретации жизни, мотивов, намерений и сложных социальных процессов. ИИ не заменяет мышление. Он лишь усиливает того, у кого мышление уже есть.

Человек с развитым мышлением получает технологическое преимущество. Человек со слабым мышлением передаёт функции мышления наружу, не получает их обратно и остаётся с убедительным текстом вместо реальности.

Фактически с появлением ИИ возник новый фактор отбора — по способности отличать речь от мышления и текст от реальности. Если этого различия нет, использование ИИ становится не инструментом, а прямым каналом психологического вреда.Не слишком ли косо смотрит на меня мой робот-пылесос?!

-

дети сами всему научатся. Я заметил что даже самые глупые дети прекрасно разбираются в том, что облегчает им жизнь. У меня знакомая есть, подросток еще, умножает числа с трудом, зато всякие геотеги как куда добраться - ваще без проблем.

ИИ как раз из этого числа, из тех вещей, что делают жизнь проще. Так что пока взрослые колеблются, запрещать или разрешать, детки уже на них свысока смотрят, тк считают что разбираются в вопросе едва ли не лучше родителей.

-

indigo197 @ 02.02.26

Она не сверяет свои ответы с реальностью, она сверяет текст с другими текстами и выстраивает вокруг этого нарратив

Во, спасибо.

Именно это я имел в виду, когда написал, что ИИ не знает, что такое хорошо, а что плохо.

supervic, не знаю, прочел ли ты статью, но она, как раз, говорит о том, что ИИ несет риски именно в том контексте, о котором ты упомянул - упрощая жизнь, только не на основе связи с реальностью, а с текстами. В Матрице это работало бы отлично, а в живой жизни - будет работать плохо. И даже, если учесть, что масса наших активностей - виртуальны, мы, все еще, живем в физическом мире, который может изрядно своротить мозг ИИ-детям.

-

rezzo, статью не читал, просто высказался на тему "стоит ли детишкам показывать ии".

Не представляю чтоб прям "своротило мозги". То что они будут иишные тексты принимать за правду? Ну так кто-то умный поправит, если эта ошибка прям вступит в противоречие с правдой. А до того будет прокатывать, пока в правде никто особо не заинтересован. То есть, грубо говоря, ребенок будет в формулах писать что число Пи равно 4, и всех это будет устраивать, пока не вступит в противоречие с кем-то серьезным и авторитетным, кто покажет и докажет что пи не 4. Или это, или другие какие-нибудь допущения приведут к несрабатыванию какого-то большого расчета в реальном мире, тогда пойдут разбираться. А мозгам то чего страдать? На каждом столбе висит объявление что ИИ врет, если ему 10 раз не сказать "ты точно в источниках смотрел, а не сам тут сочинил?" "И то, детки, если это прям что-то важное, лучше еще проверить пару раз без ИИ ключевые моменты, чтоб не краснеть потом" - такое тоже на каждом столбе.

Но. В большинстве случаев всем пофиг. Вот перепутал ИИ "Штирлица" с "Лолитой" по моему запросу. Если подавшего запрос устраивает, если дальнейшей проверки не будет - так и х с ним, зачем париться, искать, напрягать электронные мозгишки? Я ИИ в этом смысле понимаю.

Когда-то, во время учебы в универе я раз сам так делал, как ИИ. Написал реферат, по экономической географии. А там надо было указать источники, и не один, а пару штук. А я откуда-то содрал, а источники искать было некогда, и интернета тогда еще не было. Буквально чуток до него оставалось) Вот я сам название статьи и придумал. Журнал такой-то, номер такой-то, статья такая-то. Прокатило. А учитывая как мне пригодилась вся эта учеба в принципе - там с потолка можно было сочинять едва ли не больше половины всяких рефератов и тп, что и делает ИИ. Просто надо держать в голове важность проекта, и соответственно иногда проверять ИИ.

-

они сами тебя научат ИИ пользоваться. Сейчас вся домашка у зумеров и тем более альфа делается через алису, просто скидывают ей фотку и пишут "решы быстра".

Сочинения тоже ИИ пишут детям, англ тоже уже почти никто не делает сам, просто фотка в Алису и все.

-

ICanDance @ 02.02.26

они сами тебя научат ИИ пользоваться. Сейчас вся домашка у зумеров и тем более альфа делается через алису, просто скидывают ей фотку и пишут "решы быстра".

Сочинения тоже ИИ пишут детям, англ тоже уже почти никто не делает сам, просто фотка в Алису и все.

Отличный рассказ в тему:

-

-

-

supervic, твой камент предполагает, что игры с ИИ происходят в песочнице, где абсолютно безопасно или риски не критичны. Я же смотрю на это несколько шире - прокатывание с квазиправдой может привести к тому, что в ответственный момент пионер просто не увидит разницы и ладно если вылетит с работы, за то, что сделал корявый расчет, а то и, может, здоровья кого лишит.

Цепочка таких обломов, потому что фундаментальных знаний не сформировалось, может привести к перманентным обломам, психологической неуверенности и депрессии.

Это, как вариант, возможного развития событий. Наше поколение росло на хорошей базовой подготовке и мы встречаем новые фичи с этими знаниями, а они растут вместе с этим и неокрепшие умы может разъебать еще до кристаллизации черепушки :)

-

Попросил жпт немножко улучшить мою картинку, с дочерью рисовали

сделаешь красивую картинку из этого - буратино выходит из чулана в дверь а там в Нарнии его ждет страшный карабас барабас

Дочь сказала, что ей мой рисунок больше нравится, а это "убери папа, слишком страшно". ну и у Пиноккио с руками опять бардак какой-то. Шах и мат, чатжпт.

-

Все переболели, теперь мелкий затемпературил с кашлем, возили с утра в больничку. Боги маркетинга у них конечно, это должно по задумке рекламировать электронный талон, чтоб свой не потерять, но по мне так это "сходил в индонезийскую клинику, теперь на автобус домой даже монеток не осталось"

перевел, что собрали на благотворительность, 4 человека но щедро, спасибо большое

пишут, что ребенку уже часть реабилитации оплатили (половина суммы), надеюсь оклемается пацан и будет делать добрые дела.

-

Штык, какое редкое имя у папы Аниты! Почти тезка Макса))

-

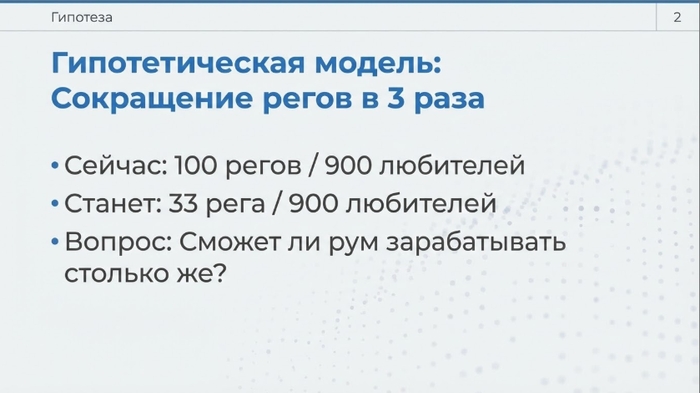

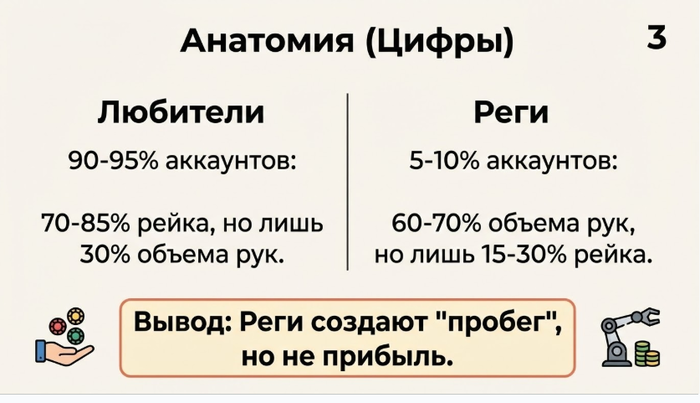

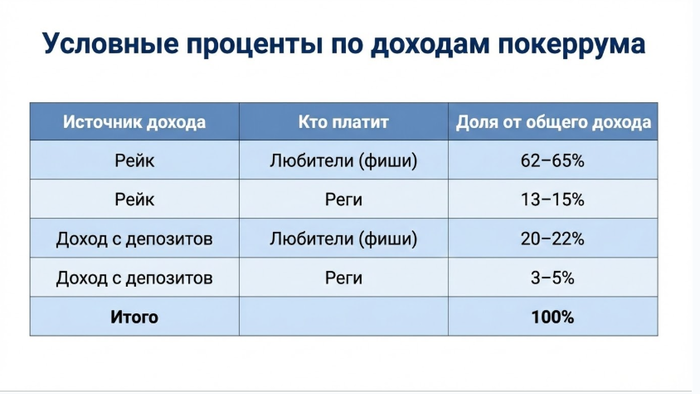

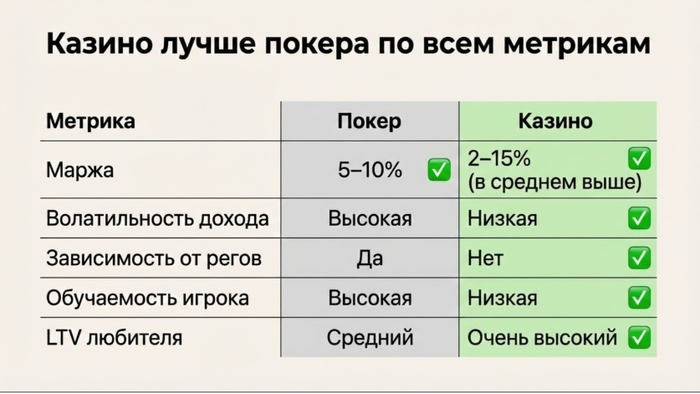

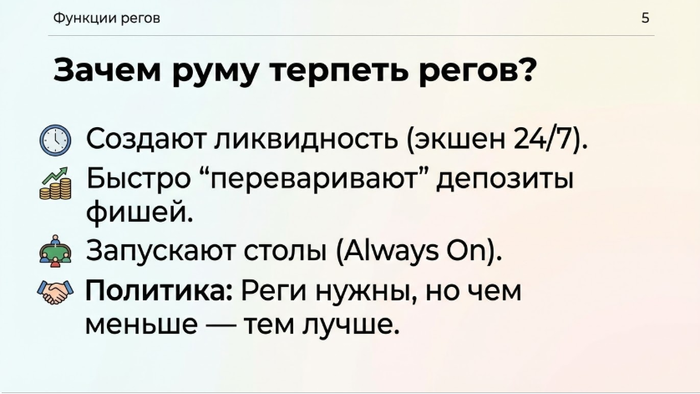

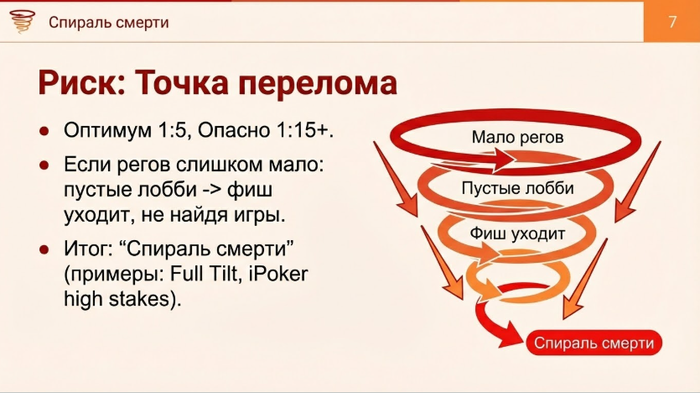

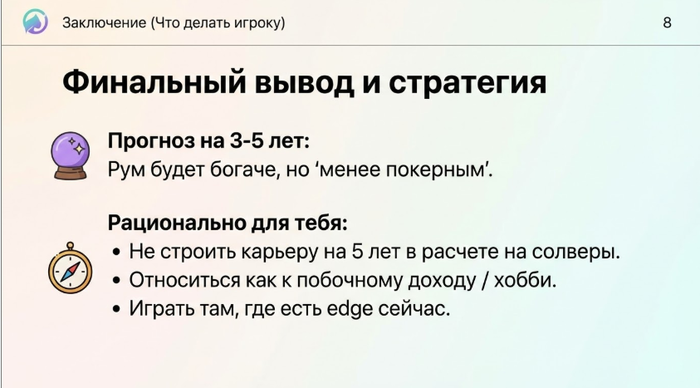

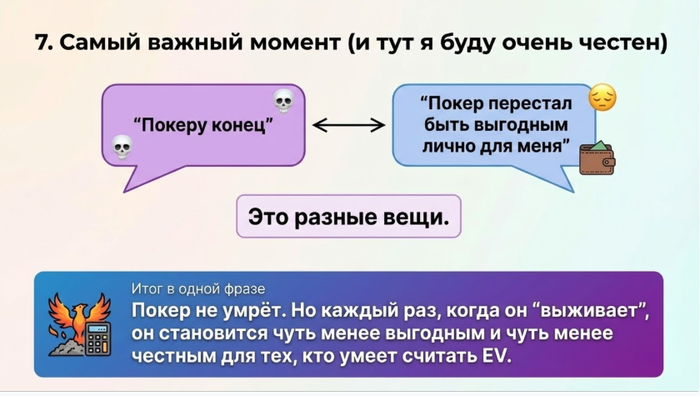

После очередной волны нытья в конфе по поводу рейкбека, мне стало интересно, почему покеррумы так не любят регов, всегда думал, что они в основном приносят деньги руму, так как месят рейка тонны. Не учел рейкбек. В общем, потрындел с нейронкой на тему экосистемы реги-любители, казино - покеррум, сделали презенташку (ну она сделала, я давал ценные указания, а то будет как в том анекдоте, где мужик говорит: "я дрова привез", а взмыленная лошадь отвечает: "охуеть, он привез"). Слайды запихаю под спойлер, может кому тоже интересно будет.

-

Штык, прикольно. Что-то очевидно, что-то не до конца.

Преза - вполне приличная (я имею в виду, визуально), огонь, ИИшенка может :)

-

Штык @ 05.02.26

мне стало интересно, почему покеррумы так не любят регов

Реги выводят деньги из системы. В идеальной для рума системе, все депозиты любителей перетираются в рейк. Собственно так бы и происходило, если бы любители играли друг с другом. И все бвбосики доставались руму. Но тут являются реги и часть этих бабосиков забирают себе.

А рейк то они платят по сути из денег любителей, поэтому руму они прибыли не приносят. Это по сути все равно что бюджетники, платящие налоги.

-

Sibarit87 @ 05.02.26

Реги выводят деньги из системы. В идеальной для рума системе, все депозиты любителей перетираются в рейк. Собственно так бы и происходило, если бы любители играли друг с другом. И все бвбосики доставались руму. Но тут являются реги и часть этих бабосиков забирают себе.

А рейк то они платят по сути из денег любителей, поэтому руму они прибыли не приносят. Это по сути все равно что бюджетники, платящие налоги.

Ну не так все просто иначе давно бы кикнули регов. скорость перемалывания депозитов у фишей друг с другом была бы намного ниже, соответственно и скорость внесения новых депозитов тоже наверное ниже, типа была бы длинная рентабельность выше, но короткая ниже)). Главное тут правильный баланс найти. Думаю разберутся, ну и надеюсь игра не превратится совсем в казино все таки. Какие-нибудь короткие мттшки наверное всегда будут в цене с шансом выиграть мульон с 10 долларов

Сообщение отредактировал Штык - 5.2.2026, 17:30 -

Там был еще один важный момент - реги создают игру.

Без них столов бы могло и вовсе не быть и фиш бы просто забил на такой рум.

-

-

Разговор ни о чем. Это как решать мат.задачу без конкретных цифр. Задаешь слишком мало вводных данных. А их у нас и не будет. Нужна статистика рума, кто и сколько депает (очевидно фиши и ммтшники), кто делает рейка больше (реги кеша). Фиши нужны кто донатит побольше, реги чтоб играли много не выводили больше чем сгенерили рейка. Игры нужны где много рейка генерится, чтобы в этих играх у регов было пониже ожидание. Как пример раш покер покерка или их же 9 мах столы. Рейкбек естестевенно прогрессивный. От уровня "совсем нихуя" до " о спасибо, я хоть поем".

- Вы сможете оставлять комментарии, оценивать посты, участвовать в дискуссиях и повышать свой уровень игры.

- Если вы предпочитаете четырехцветную колоду и хотите отключить анимацию аватаров, эти возможности будут в настройках профиля.

- Вам станут доступны закладки, бекинг и другие удобные инструменты сайта.

- На каждой странице будет видно, где появились новые посты и комментарии.

- Если вы зарегистрированы в покер-румах через GipsyTeam, вы получите статистику рейка, бонусные очки для покупок в магазине, эксклюзивные акции и расширенную поддержку.

По всему миру сходят, вопрос в приложенных усилиях и полученном профите. Пока, сюда по тем оценкам, что мне попадались - выхлоп мизерный, а уж сами компании, выдающие модели - в глубоком минусе.

Но то, что ИИшенка находит уже и найдет в будущем определенные ниши в рабочих процессах - безусловно.

Естественно, я имел в виду общение с учетом этих ограничений. Хочешь купить подписку - покупаешь, хочешь рассказать детям что-то - алга в зум, слушай. Обсуждать все подряд - у меня это только мораль убивает, лично я отказался от таких бесед и мне проще потом послушать негодования - зачем так сделал и проигнорировать их :)

И, да, я тоже не считаю ее плохой матерью, но есть определенные девиации у разных профессий (медики, полиция, преподаватели и пр.), которые изрядно мешают восприятию, а еще и личные мировоззренческие концепции могут накладываться, тогда совсем аллес.